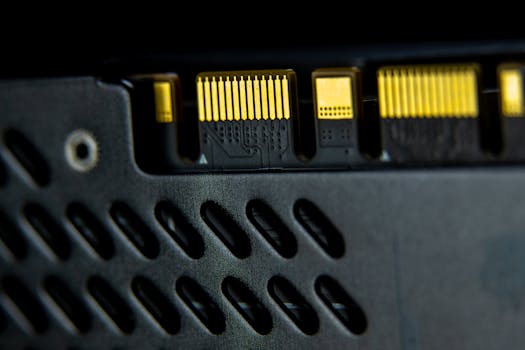

Deep Dive PCIe Transaction Layer: Latency dan Overhead pada Sistem Modern

Pernah nggak sih ngerasa gini: spek sistem udah gahar, pakai NVMe SSD PCIe Gen 4 atau Gen 5 yang katanya kenceng banget, tapi pas ngejalanin aplikasi yang I/O-heavy kayak database, virtualisasi, atau data processing, kok rasanya masih ada 'nge-lag' atau performanya nggak sesuai ekspektasi? Data transfer rate udah tinggi, tapi responsivitasnya masih bikin gregetan. Nah, kalau kamu pernah ngalamin itu, kemungkinan besar kamu sedang berhadapan langsung dengan 'hantu' di balik layar: latency dan overhead di lapisan transaksi PCIe, yang sering luput dari perhatian.

Seringnya, kita cuma fokus ke bandwidth mentah PCIe, "Oh, Gen 5 kan 32 GT/s per lane, pasti kenceng!" Betul, itu bandwidth. Tapi di dunia I/O yang sebenarnya, terutama yang sifatnya random access atau banyak transaksi kecil, latency itu sama pentingnya, bahkan kadang lebih penting. Dan di sinilah Transaction Layer PCIe memainkan peran krusial.

Kenapa Latency dan Overhead Ini Bisa Jadi Masalah Utama?

Begini, PCIe itu bukan cuma sekadar pipa data. Ada protokol yang kompleks untuk memastikan data sampai dengan benar, berurutan, dan terjamin. Transaction Layer itu ibarat 'otak' di atas pipa tersebut. Di lapisan inilah semua request untuk membaca atau menulis data (disebut Transaction Layer Packets atau TLP) dibuat dan dikelola. Ini beberapa penyebab utamanya:

- Posted vs. Non-Posted Transactions: Ini fundamental.

- Posted Transactions (misalnya, Write): Setelah request dikirim, pengirim (requestor) nggak perlu nunggu konfirmasi kalau data udah diterima sama penerima (completer). Langsung aja kirim request berikutnya. Ini bagus buat throughput tinggi tapi kalau ada error ya susah dideteksi.

- Non-Posted Transactions (misalnya, Read atau Write dengan Completion): Nah, kalau ini, requestor wajib nunggu 'Completion' atau balasan dari completer bahwa request sudah diproses. Setiap read request butuh completion. Setiap completion itu butuh waktu dan resource. Bayangin kalau aplikasi kamu sering banget ngirim read request kecil-kecil, setiap request harus nunggu balasan. Ini langsung nyumbang latency signifikan.

- Credit-Based Flow Control: Mirip kayak sistem token. Setiap device punya sejumlah 'credit' untuk bisa ngirim TLP. Kalau credit habis, dia harus nunggu sampai ada credit lagi yang dibalikin sama lawan bicaranya. Ini mencegah buffer overflow, tapi juga bisa jadi bottleneck kalau credit sering habis dan lama di-refresh. Apalagi kalau ada bottleneck di perangkat lain atau switch, credit bisa macet.

- TLP Overhead: Setiap TLP itu punya header. Mau datanya cuma 1 byte atau 4KB, headernya tetap ada. Header ini nambah overhead. Kalau transaksi kamu banyak yang kecil-kecil, porsi overhead dari header ini jadi relatif besar dibanding data payload-nya.

- Queue Depth & Ordering: Device PCIe punya queue untuk menampung request. Kalau queue-nya nggak dikelola dengan baik, atau terlalu dangkal/terlalu dalam, bisa nambah latency. Lalu ada aturan ordering untuk memastikan data nggak ketuker, ini juga bisa nambah sedikit tunda.

- Topologi dan Switch: Setiap kali TLP harus melewati PCIe switch, ada sedikit overhead tambahan karena harus di-routing dan diproses lagi. Semakin jauh perangkat dari Root Complex (CPU), semakin banyak hop yang dilalui, semakin tinggi potensial latencynya.

Dampak Kalau Latency dan Overhead Dibiarin Aja

Efeknya? Jelas, performa sistem jadi nggak optimal. Meskipun bandwidth tinggi, tapi kalau latency juga tinggi, aplikasi kamu bakal sering 'nongkrong' nungguin data. Ini sering banget kejadian di skenario:

- Database: Transaksi kecil yang banyak dan random read/write. Kalau latency tinggi, query jadi lambat, performa OLTP anjlok.

- Virtualisasi/Container: Setiap VM atau container butuh I/O sendiri-sendiri. Agregasi latency dari semua workload bisa bikin host kewalahan.

- AI/ML Workloads: GPU yang lagi ngolah data perlu akses memori atau storage cepat. Kalau aksesnya lambat karena latency, GPU bisa 'idle' nunggu data, ngurangi efisiensi.

- High-Frequency Trading: Setiap mikrodetik itu berharga. Latency sekecil apa pun bisa berarti kalah saing.

Intinya, resource CPU dan memori bisa jadi nganggur karena cuma nungguin I/O. Efisiensi energi juga terpengaruh karena komponen jadi kerja lebih lama untuk menyelesaikan tugas yang sama.

Solusi Praktis dan Realistis untuk Mengurangi Latency dan Overhead

Oke, sekarang gimana cara nguranginnya? Ini beberapa pendekatan yang bisa kamu coba dan perhatikan:

- Optimasi Queue Depth: Ini sering kali jadi low-hanging fruit. Jangan biarkan aplikasi atau driver menggunakan queue depth yang terlalu rendah (yang bisa bikin perangkat idle) atau terlalu tinggi (yang bisa nambah overhead karena manajemen antrian). Eksperimen dengan nilai optimal untuk workload kamu.

- Batching atau Coalescing Transaksi: Kalau bisa, usahakan aplikasi atau driver untuk menggabungkan banyak request kecil menjadi satu request besar. Misalnya, daripada 1000 kali Read 4KB, mending 1 kali Read 4MB. Ini mengurangi overhead header TLP dan jumlah completion yang harus diproses.

- Manfaatkan DMA (Direct Memory Access): Pastikan perangkat PCIe (khususnya yang kenceng kayak NVMe SSD atau NIC) bisa menggunakan DMA secara efisien untuk transfer data langsung ke dan dari memori sistem, tanpa perlu intervensi CPU terlalu banyak. Ini mengurangi beban CPU dan mempercepat transfer.

- Pahami Perilaku Workload: Identifikasi apakah workload kamu dominan random read/write, sequential, atau kombinasi. Prioritaskan optimasi sesuai karakteristiknya. Untuk random access, latency jauh lebih penting.

- Pilih Hardware yang Tepat: Bukan cuma kecepatan Gen-nya, tapi juga kualitas kontroler PCIe di perangkat (misal, di SSD NVMe, NIC, atau HBA). Kontroler yang bagus akan lebih efisien dalam mengelola TLP, credit, dan antrian.

- Topologi PCIe yang Optimal: Tempatkan perangkat yang paling sensitif terhadap latency sedekat mungkin ke Root Complex. Hindari melewati terlalu banyak PCIe switch atau bridge kalau memang nggak perlu. Kadang, konfigurasi slot PCIe di motherboard juga punya impact.

- Driver yang Efisien: Driver yang ditulis dengan baik akan mengoptimalkan cara berkomunikasi dengan perangkat melalui Transaction Layer. Pastikan driver selalu up-to-date dan dioptimalkan untuk performa.

Tips Tambahan atau Insight yang Jarang Dibahas

- Vendor-Specific Features: Beberapa produsen hardware punya fitur atau setting firmware khusus untuk optimasi latency. Jangan sungkan untuk explore user guide atau support forum mereka. Contoh: pengaturan QoS di NIC atau mode latency rendah di SSD enterprise.

- Profiling adalah Kunci: Jangan cuma nebak-nebak. Gunakan tools profiling yang bisa melihat I/O latency di level sistem operasi (misalnya

perfdi Linux,Process Monitordi Windows) sampai ke level hardware (kalau ada tools dari vendor). Cari tahu di mana bottleneck sebenarnya. Apakah di CPU, memori, atau memang di jalur PCIe? - Interrupt Moderation: Untuk perangkat I/O yang sangat cepat, sering terjadi interupsi ke CPU. Interrupt moderation bisa menggabungkan beberapa interupsi menjadi satu, mengurangi overhead CPU, tapi bisa sedikit nambah latency di aplikasi yang sensitif. Ini trade-off yang perlu kamu sesuaikan.

- Memahami Cache Line: Terutama untuk DMA, pastikan data yang ditransfer sejajar dengan cache line CPU (biasanya 64 byte). Transfer data yang tidak sejajar bisa menyebabkan "false sharing" atau inefisiensi cache, yang ujung-ujungnya nambah latency juga.

Mengerti seluk beluk Transaction Layer PCIe ini memang nggak semudah membalik telapak tangan. Ini butuh pemahaman mendalam tentang bagaimana sistem kamu bekerja. Tapi, dengan fokus pada optimasi latency dan overhead di level ini, kamu bisa membuka potensi performa penuh dari hardware mahal yang sudah kamu beli. Jadi, jangan cuma liat angka bandwidth doang ya, latency itu beneran krusial!

Posting Komentar untuk "Deep Dive PCIe Transaction Layer: Latency dan Overhead pada Sistem Modern"

Posting Komentar

Berikan komentar anda